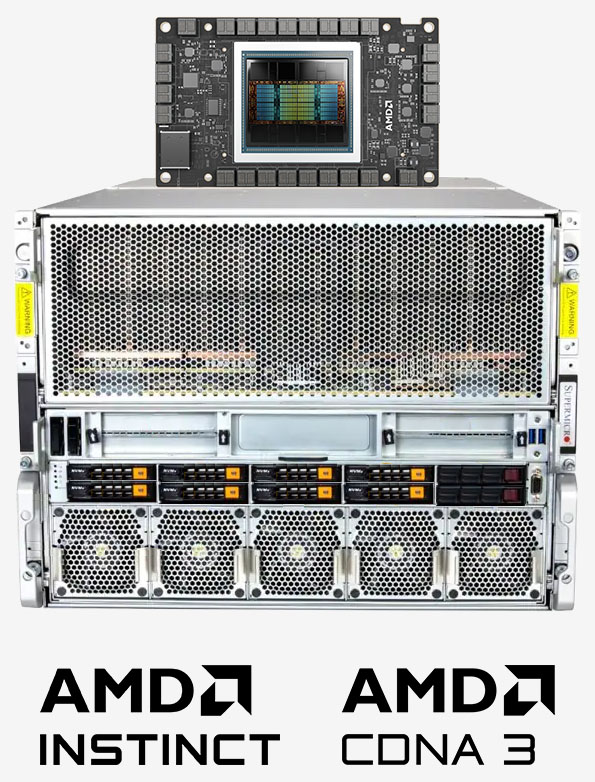

AMD Instinct™

AMD Instinct™ MI325X für KI, HPC und datenintensive Anwendungen

Die AMD Instinct™ MI325X GPU-Beschleuniger setzen neue Maßstäbe in der KI-Leistung und Effizienz. Basierend auf der 3. Generation der AMD CDNA™ Architektur bieten sie herausragende Performance für Training und Inferenz von KI-Modellen. Mit einer branchenführenden Speicherkapazität von 256 GB HBM3e und einer Speicherbandbreite von 6.0 TB/s sind sie darauf ausgelegt, die Leistung zu maximieren und die Gesamtbetriebskosten zu optimieren.

Key Features der AMD Instinct™ MI325X Systeme

Speziell entwickelt für KI und High Performance Computing!

Als AMD Elite Partner sind wir gerne Ihr Ansprechpartner, wenn es um leistungsstarke und hochverfügbare MI325X Server-Lösungen für Rechenzentren, Forschung und Industrie geht.

Mehr zu AMD Instinct™ MI325X Beratung anfordern

Kategorien

Sortieren nach:

GIGABYTE GPU Server AMD Instinct™ MI350X G893-ZX1-AAX3

- 8 HE Rack Server Gehäuse

- 2x AMD EPYC 9005 CPU

- 8x AMD Instinct™ MI350X GPU

- bis zu 6.0 TB DDR5-5600 RAM

- 8x 2.5" NVMe Festplatteneinschübe

- 2x M.2 PCIe 3.0 x4 (2280, 22110)

- 4x PCIe 5.0 x16 Dual-Slot (FHHL)

- 8x PCIe 5.0 x16 Single-Slot (FHHL)

Preisanfrage

Jetzt vorbestellen

AMD Instinct™ MI325X - Entwickelt für die Beschleunigung moderner Workloads

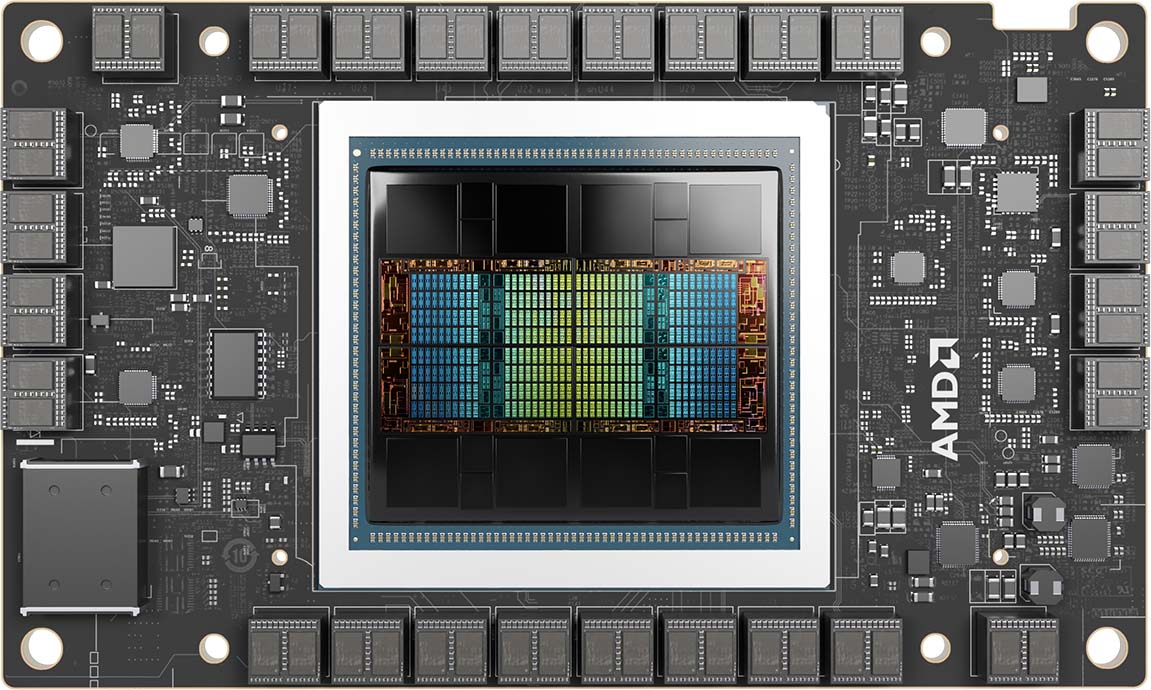

Die steigenden Anforderungen generativer KI, großer Sprachmodelle, Inferenz und des maschinellen Lerntrainings stellen höchste Ansprüche an GPU-Beschleuniger. Die AMD Instinct™ MI325X GPU bietet überragende Leistung für eine Vielzahl von Datentypen, die für KI-Software benötigt werden, darunter FP16, BF16, FP8 und INT8 – essenziell für hochpräzise Inferenz und Training. Mit branchenführenden 256 GB HBM3e-Speicher und einer Bandbreite von 6.0 TB/s kann ein einzelner Beschleuniger ein Ein-Billion-Parameter-Modell speichern und verarbeiten, während gleichzeitig die Gesamtbetriebskosten für ausgewählte große Sprachmodelle gesenkt werden.

Die Unterstützung von Matrix-Sparsity optimiert den Speicherverbrauch und steigert die Rechengeschwindigkeit, wodurch eine nachhaltige Skalierung von KI-Lösungen in Rechenzentren ermöglicht wird. Dies beschleunigt die Markteinführung und verbessert die Gesamtleistung.

AMD Instinct™ MI325X DatenblattBringen Sie Ihre KI- und HPC-Workloads auf ein neues Level

Konzipiert für KI- und HPC-Anwendungen eignen sich die AMD Instinct™ Beschleuniger der MI300-Serie dank der außergewöhnlichen Rechenleistung, der großen Speicherdichte, der im Chip integrierten High Bandwidth Memory und dem Support für spezielle Datenformate optimal für Ihre anspruchsvollsten Workloads.

Die Beschleuniger der AMD Instinct™ MI300-Serie basieren auf der AMD CDNA™ 3 Architektur. Durch die Matrix-Core-Technologie und die Unterstützung für eine Vielzahl von verschiedenen Genauigkeiten - vom hocheffizienten INT8 und FP8 mit Sparsity-Support bis zu anspruchvollsten FP64 für HPC - bieten die AMD Instinct™ MI300-Beschleuniger zahlreiche Einsatzmöglichkeiten im Bereich von KI und HPC.

Mehr zur AMD CDNA™ 3 Architektur

304

CUs / GPU

Recheneinheiten

256 GB

HBM3e

Speicher

896 GB/s

GPU-to-GPU

Bandbreite

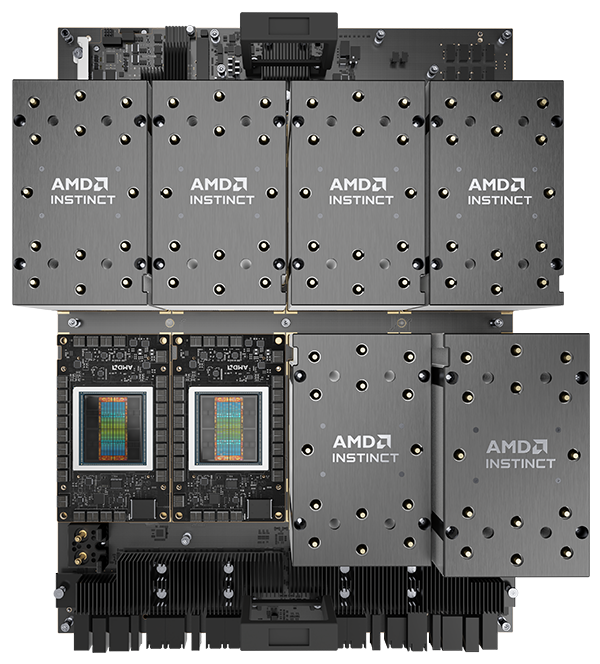

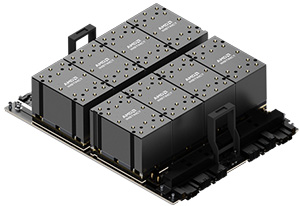

Die AMD Instinct™ MI325X Plattform vereint 8 vollständig vernetzte MI325X GPU OAM-Module in einem OCP-Design nach Branchenstandard, die über AMD Infinity Fabric™ Links der 4. Generation miteinander verbunden sind. Dadurch bietet sie bis zu 2.0 TB HBM3-Speicher für KI-Berechnungen mit geringer Latenz. Diese einsatzbereite Plattform ermöglicht eine schnellere Markteinführung und senkt die Entwicklungskosten, indem sie die Integration der MI300X Beschleuniger in bestehende KI-Rack- und Serverstrukturen erleichtert.

Mehr über AMD Instinct™ MI300X8x MI325X

GPU

OAM-Module

2.0 TB

gesamter

HBM3e-Speicher

6.0 TB/s

max.

Speicherbandbreite

Jetzt Kontakt aufnehmen und von unseren AMD Instinct™ Experten beraten lassen

Kontaktieren Sie uns gern jederzeit.